目录

导语

2026年的周一早晨,你刚坐下,电脑就弹出了云端大模型的续费账单——由于算力通胀,团队版月费又涨了30%。更让你背脊发凉的是,上周HR误将一份包含全员薪资的敏感文件丢给云端AI做“离职倾向分析”,这类数据泄露在2026年不再是公关危机,而是初创公司的“死刑判决”。随后,由于跨海光缆波动,云端AI集体掉线,全公司陷入瘫痪。

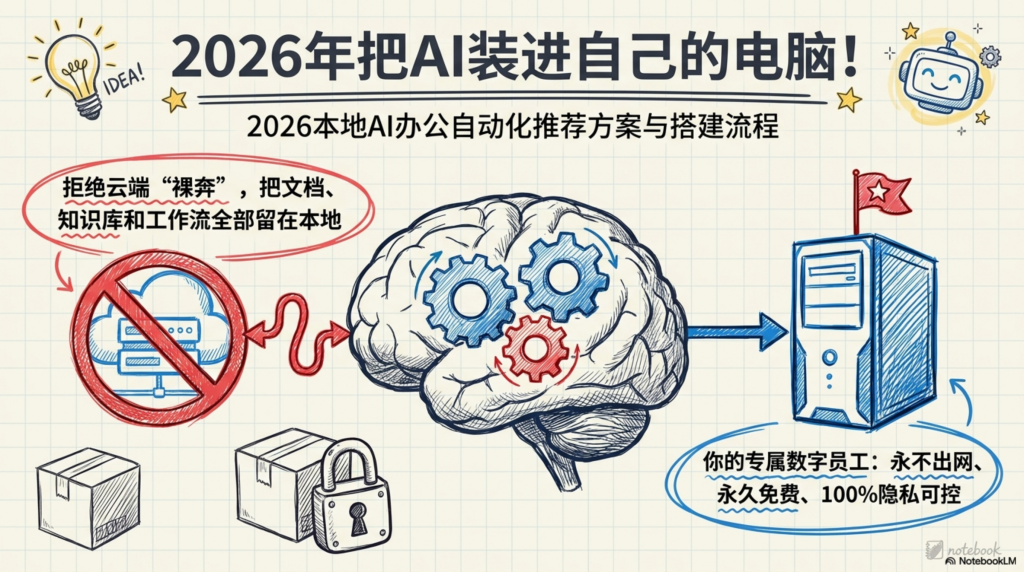

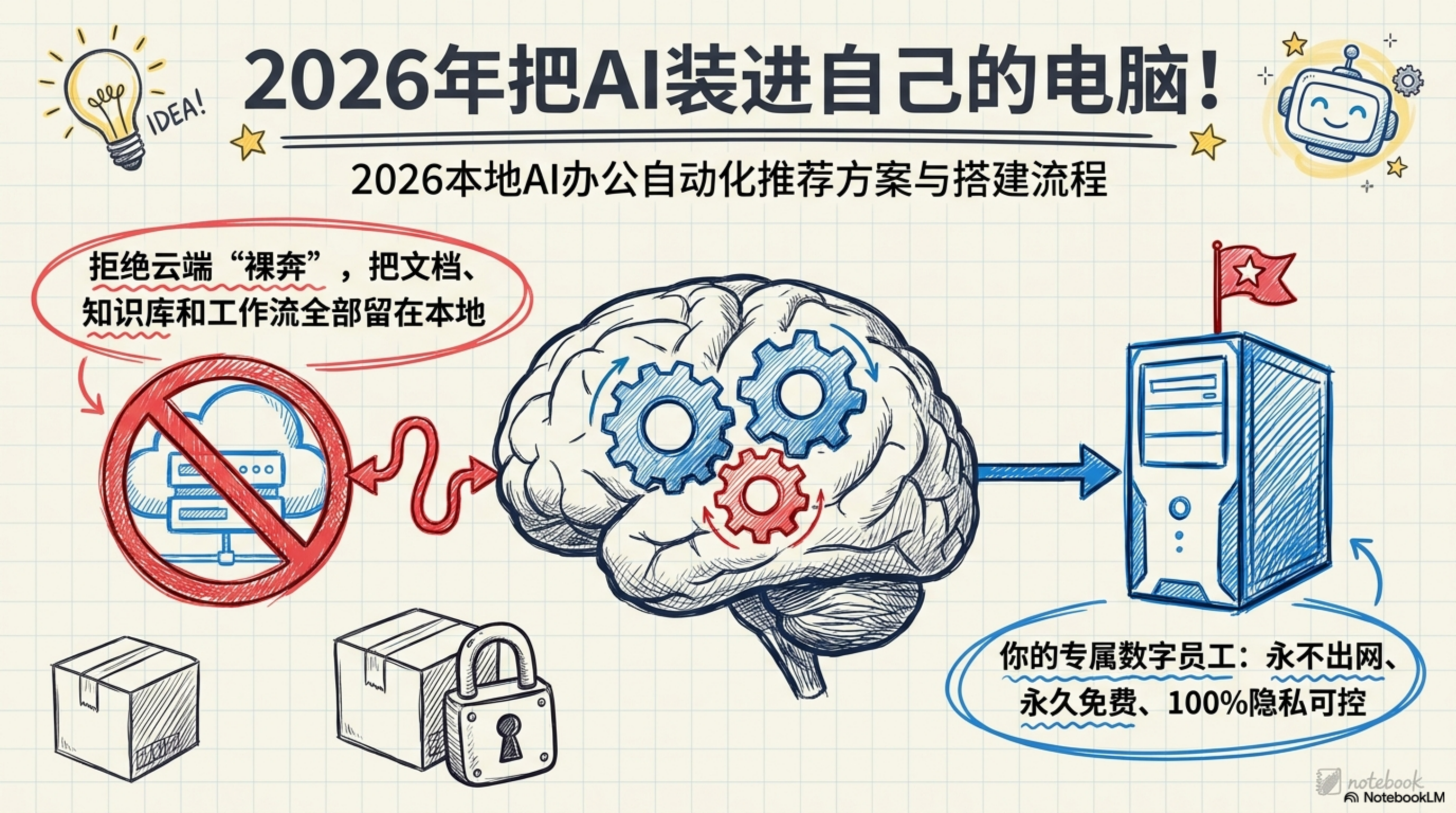

如果你正被云端厂商“割肉”式订阅费勒得喘不过气,或者每天在“效率”与“隐私”的刀尖上行走,那么请看好:2026年,本地AI技术已经彻底熟化。我们要谈的不是简单的聊天框,而是一套数据不出户、永久免费、全自动运行的“数字大脑”。这一篇,我将实战经验倾囊相授,手把手教你把AI办公权夺回自己手里。

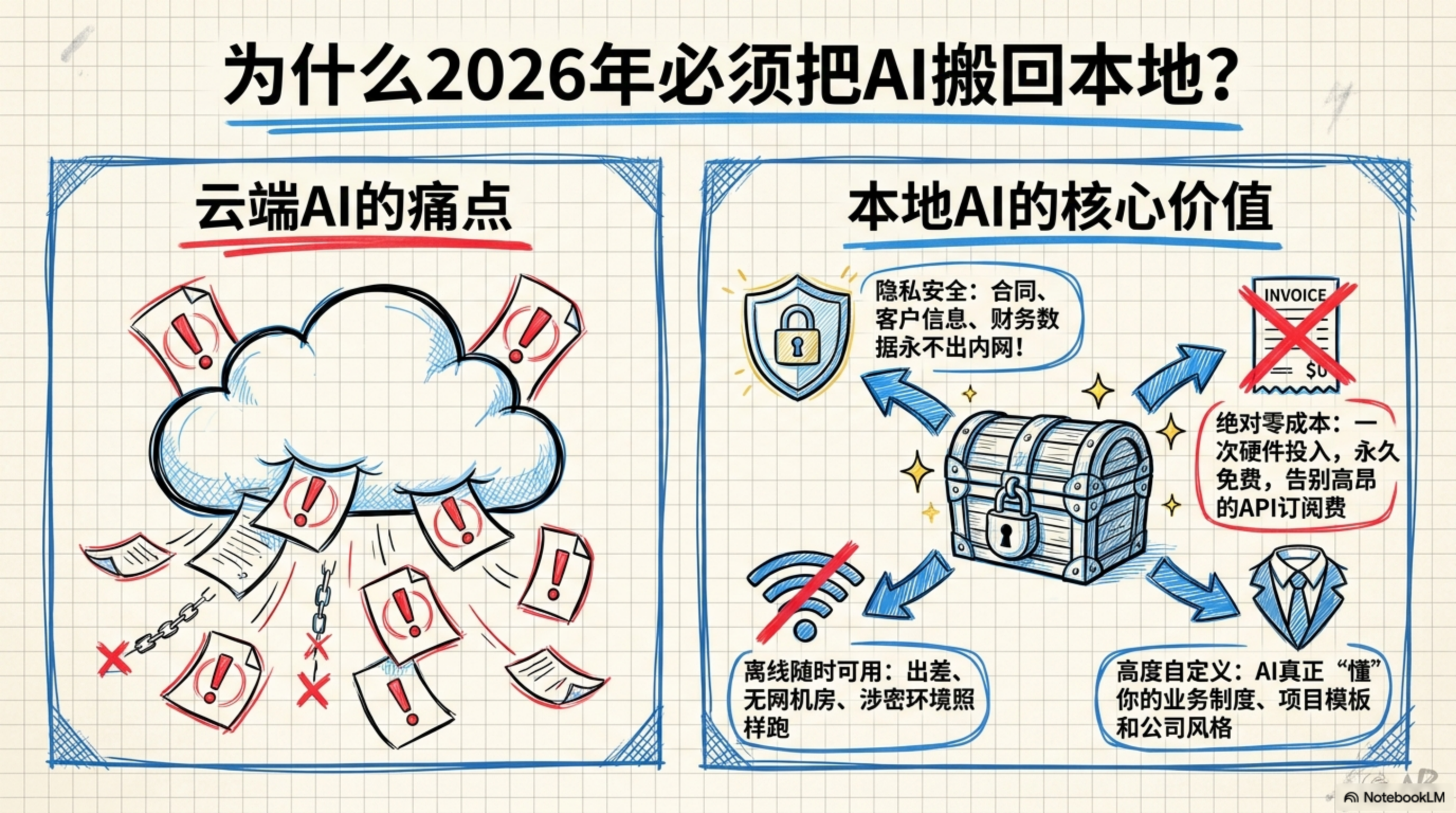

一、为什么2026年必须把AI办公搬回本地?

在AI发展的下半场,企业竞争的本质已从“比拼谁会用AI”转向“比拼谁的私有资产更安全”。从“云端依赖”转向“本地主权”,这不仅是技术选型,更是关乎企业生存的战略博弈。

- 隐私安全:数据泄露即“死刑” 在云端,你的每一份合同、每一个专利都在为别人的模型提供养料。本地化部署意味着敏感资料(财务报表、核心代码、客户名录)永远留在内网,通过物理隔离彻底封死泄露路径。

- 零成本优势:一笔稳赚不赔的ROI账 给一个10人团队开通全套云端AI订阅,每月开销约300。18个月下来就是5400(约3.8万人民币)——这笔钱足够配一台顶配双显卡本地服务器。从第19个月开始,你的AI推理成本归零。这种一次性投入带来的长期边际成本优势,是任何云端订阅无法企及的。

- 深度定制化:让AI长出“公司脑子” 云端大模型是“通用才子”,但它不懂你的项目历史。本地AI能深度“吞掉”你的私有知识库,生成的每一行文案、每一份方案都自带公司调性,拒绝AI味,只求业务味。

核心逻辑: 本地化部署不是技术复古,而是为了实现AI主权。

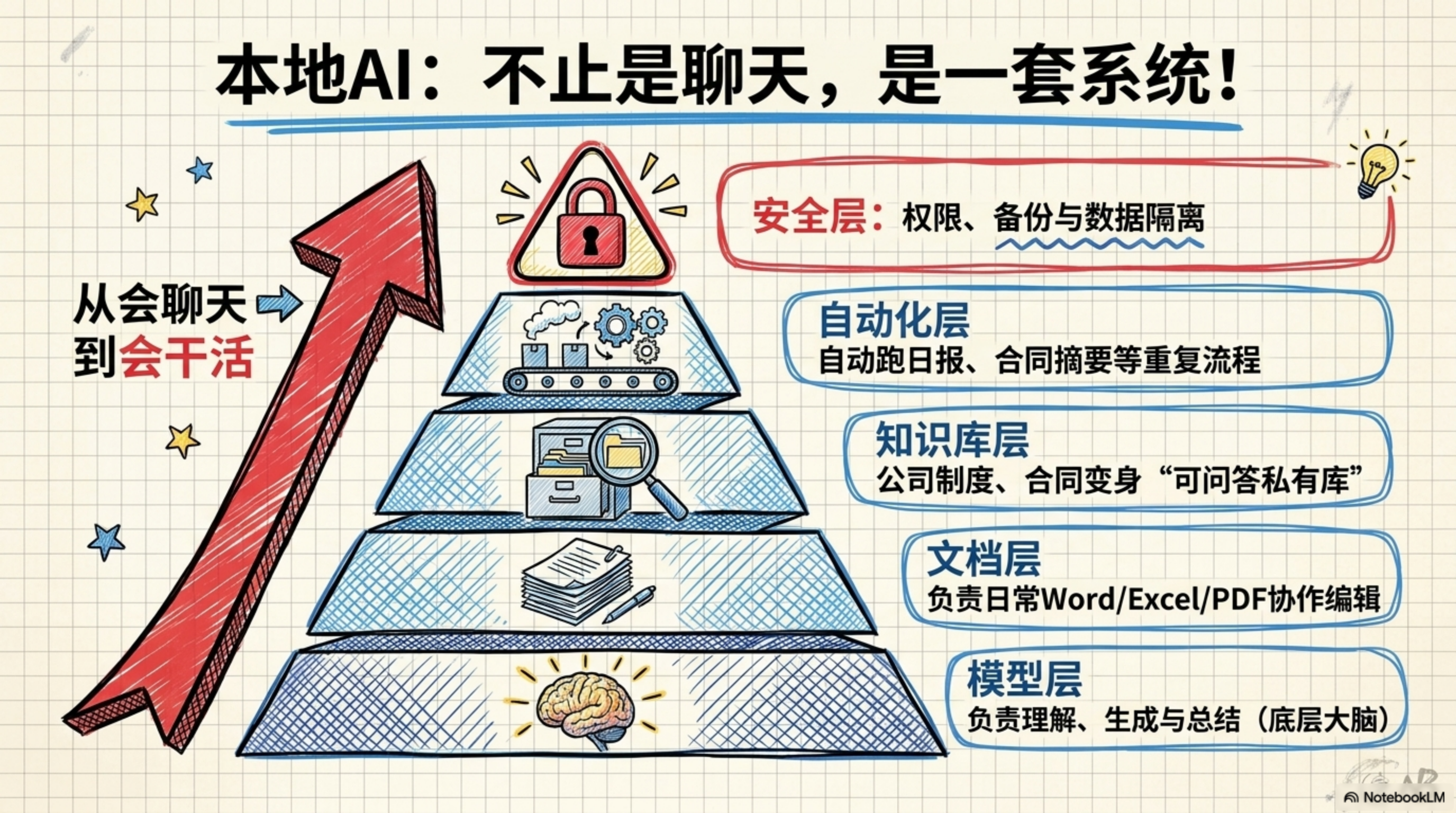

二、本地AI办公到底是一套什么样的系统?

真正的本地AI办公系统绝非一个简单的对话框,而是一个五层协作的复杂生态,缺一不可:

- 模型层(推理核心): 系统的大脑。利用Ollama或llama.cpp等引擎运行,负责理解指令、生成内容。

- 文档层(协作中心): 取代Office 365。通过OnlyOffice等工具实现Word、Excel、PPT的在线协同编辑。

- 知识库层(RAG深度挖掘): 系统的记忆。将海量私有文档向量化,实现“基于公司事实”的精准问答。

- 自动化层(数字员工): 系统的手脚。利用n8n等工具串联跨软件任务,把问答变成自动化的工作流。

- 安全层(权限管理): 系统的堡垒。负责VPN接入、权限隔离及数据冷备份。

三、2026年最推荐的三套方案

根据不同规模,我整理了这三套经过实战检验的最优配置方案。

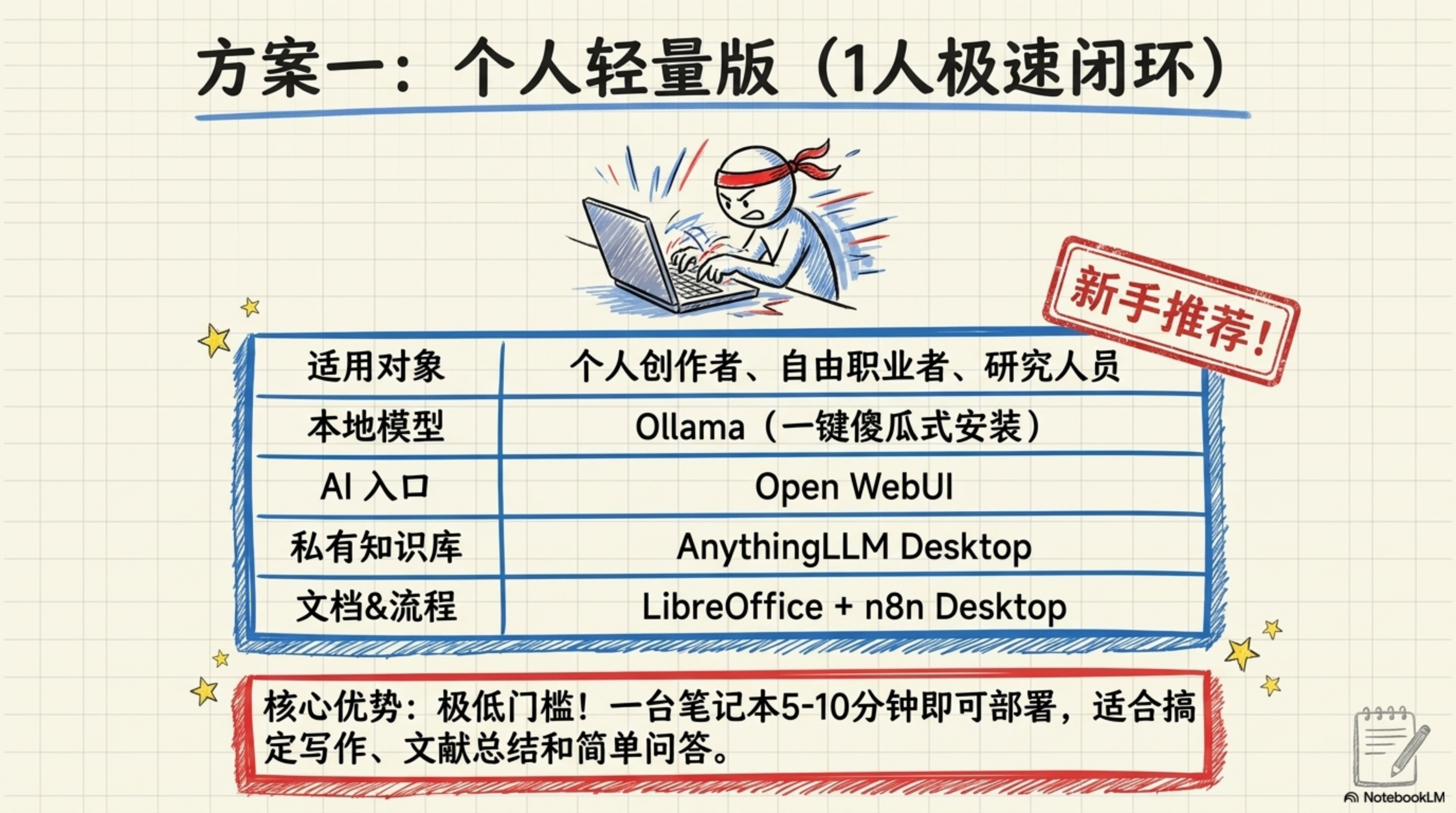

方案一:个人轻量版(适合创作者/自由职业者)

重点在于“单机闭环”,5分钟部署,随时拎走。

| 模块 | 推荐组合 | 硬件建议 | 核心优势 |

| 本地模型 | Ollama | Mac mini M系列 (16GB+) | 安装门槛极低 |

| 界面入口 | Open WebUI Desktop | 或 RTX 3060 12GB | 类ChatGPT丝滑体验 |

| 知识库 | AnythingLLM Desktop | 32GB 内存 | 个人文档秒变知识库 |

| 自动化 | n8n Docker版 | 存储 SSD 1TB | 简单处理个人工作流 |

| 预算估计 | 约 ¥5,000 – ¥8,000 |

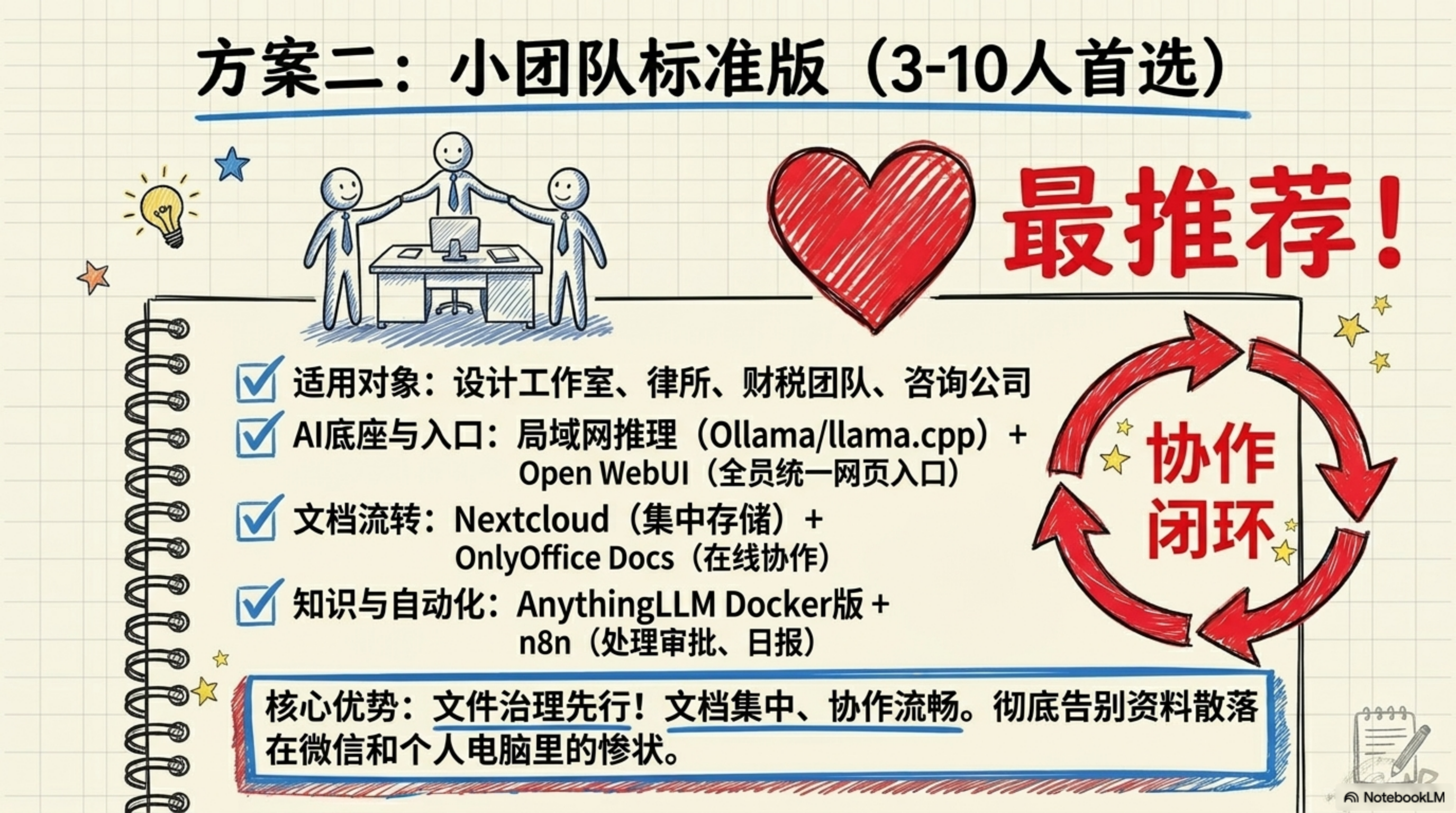

方案二:3-10人工作室标准版(最推荐)

追求团队协同与性价比,这是小企业的“数字员工”首选。

| 模块 | 推荐组合 | 硬件建议 | 核心优势 |

| 模型服务 | Ollama (LAN局域网推理) | RTX 4090 / 双卡 | 算力共享,多人不卡顿 |

| 协作中心 | Nextcloud + OnlyOffice | 64GB+ 内存 | 文档集中管理,在线协同 |

| 知识库 | AnythingLLM Docker版 | 独立AI主机 | 支持多用户权限隔离 |

| 自动化 | n8n 社区版 | 2TB NVMe SSD | 自动生成日报/合同摘要 |

| 预算估计 | 约 ¥20,000 – ¥35,000 |

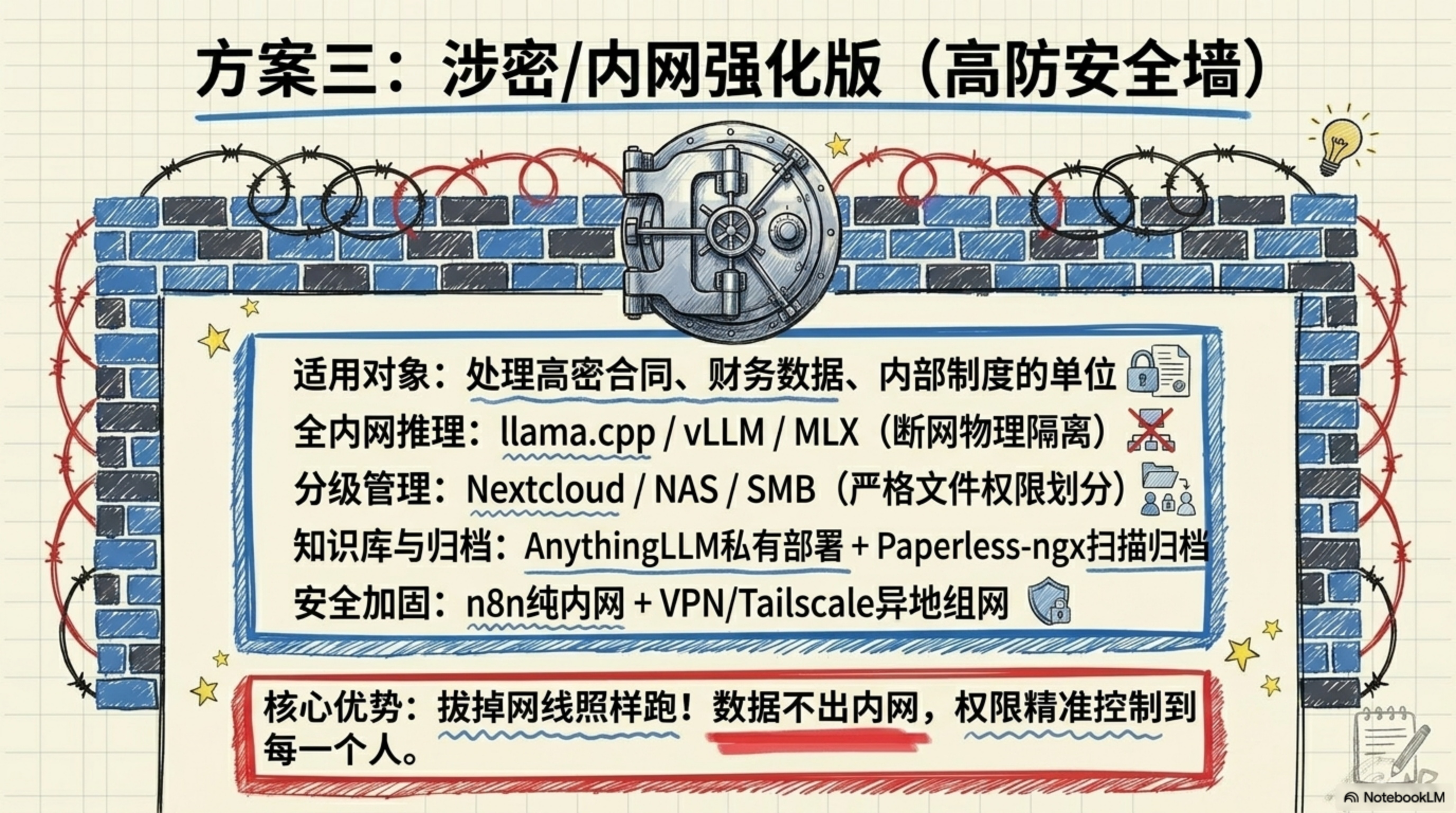

方案三:涉密/内网强化版(高安全性)

追求极致安全,适合处理敏感合同、财务数据的单位。

| 模块 | 推荐组合 | 安全策略 | 核心优势 |

| 推理后端 | llama.cpp / vLLM | 物理断网/独立内网 | 压榨硬件性能极限 |

| 文件权限 | NAS / 私有服务器 | 权限分级管理 | 数据冷备份,防止误删 |

| 归档工具 | Paperless-ngx | 硬件防火墙 | 纸质合同OCR自动化归档 |

| 访问控制 | VPN / Tailscale | 严禁公网暴露端口 | 安全远程访问,数据零出户 |

| 预算估计 | 根据具体服务器配置定制 |

互动思考: 你们公司哪一类数据最让你担心“上云”风险?如果是合同或财务数据,方案三是你的唯一选择。

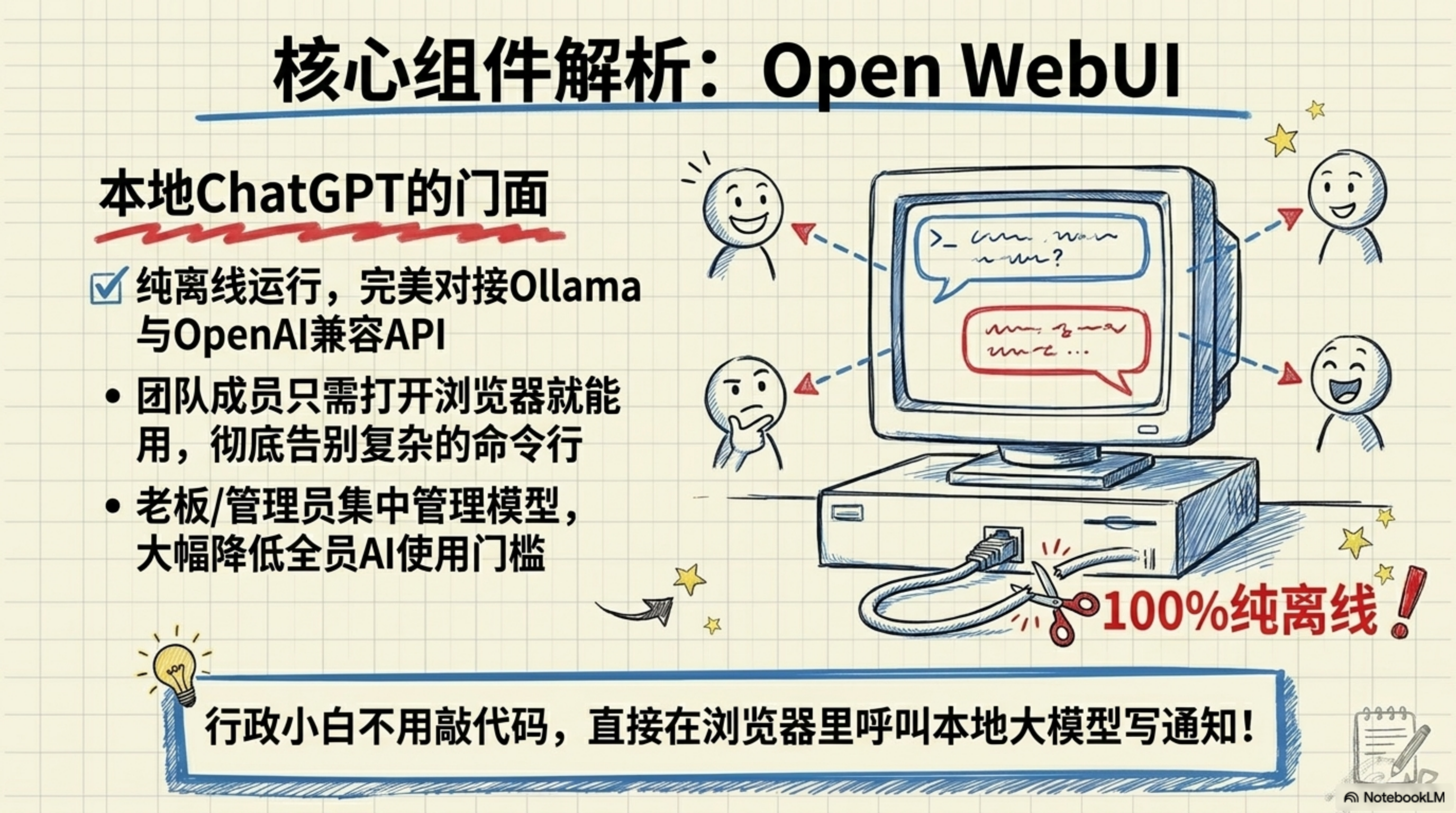

四、核心组件深度拆解:为什么这些是2026年的最优选?

- Open WebUI:本地AI的第一入口 它不仅提供精美的UI,更支持多用户管理。它是团队的统一网关,免去了每个人都在命令行里摸索的痛苦。

- AnythingLLM:RAG方案的集大成者 它的“工作区”理念无敌——你可以为财务、技术、人事分别建立独立的知识库,互不干扰,检索准确率极高。

- OnlyOffice + Nextcloud:超越Office 365 为什么选OnlyOffice而不是LibreOffice?因为OnlyOffice的“连接器稳定性”和在线编辑兼容性更好,生成的AI文案可以直接在浏览器里团队润色。

- n8n:连接一切的“数字胶水” 它是实现“自动干活”的关键。专家警告: 根据2026年TechRadar安全报告,请务必不要将n8n暴露在公网,必须配合VPN使用。

- Paperless-ngx:纸质资料的数字重生 这才是真正的自动化:当你把纸质合同往扫描仪一丢,Paperless-ngx自动OCR识别,n8n捕获后传给AnythingLLM,几秒钟后,这份合同就变成了你知识库里的一条可检索信息。

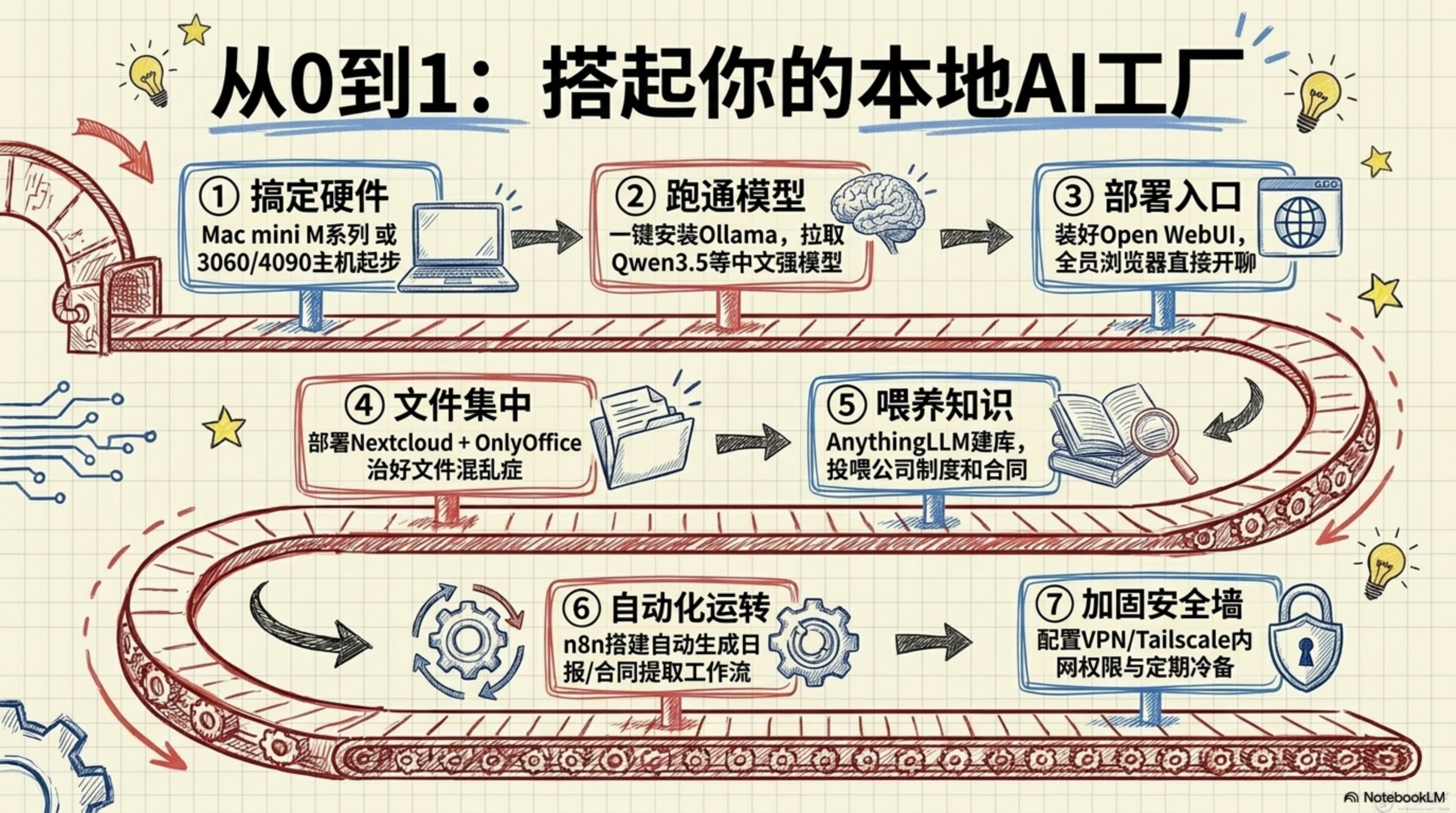

五、从0到1完整搭建流程(手把手教学)

别被技术名词吓到,跟着这个逻辑走,小白也能跑通:

- 硬件就位: 记住原则——显存(VRAM) > 内存 > 算力。显存大小决定了你能跑多大、多聪明的模型。

- 模型部署: 安装Ollama,在终端执行

ollama pull qwen3.5:14b。这是2026年中文办公最平衡的模型,通过量化(Quantization)技术,它能在普通显卡上跑出极速。 - 界面集成: Docker部署Open WebUI,将API连接指向Ollama的

11434端口。 - 文档协作: 部署Nextcloud并挂载OnlyOffice连接器。确保团队所有文件都在这套系统里流动,而不是零散在微信。

- 知识库注入: 在AnythingLLM里创建工作区,进行文档切分(Chunking)优化。记住:不要把乱七八糟的文件一股脑塞进去,高质量的切分才有高质量的回答。

- 自动化串联: 在n8n中拖入Ollama节点。设置一个WebHook,让它监听Nextcloud的文件变动。

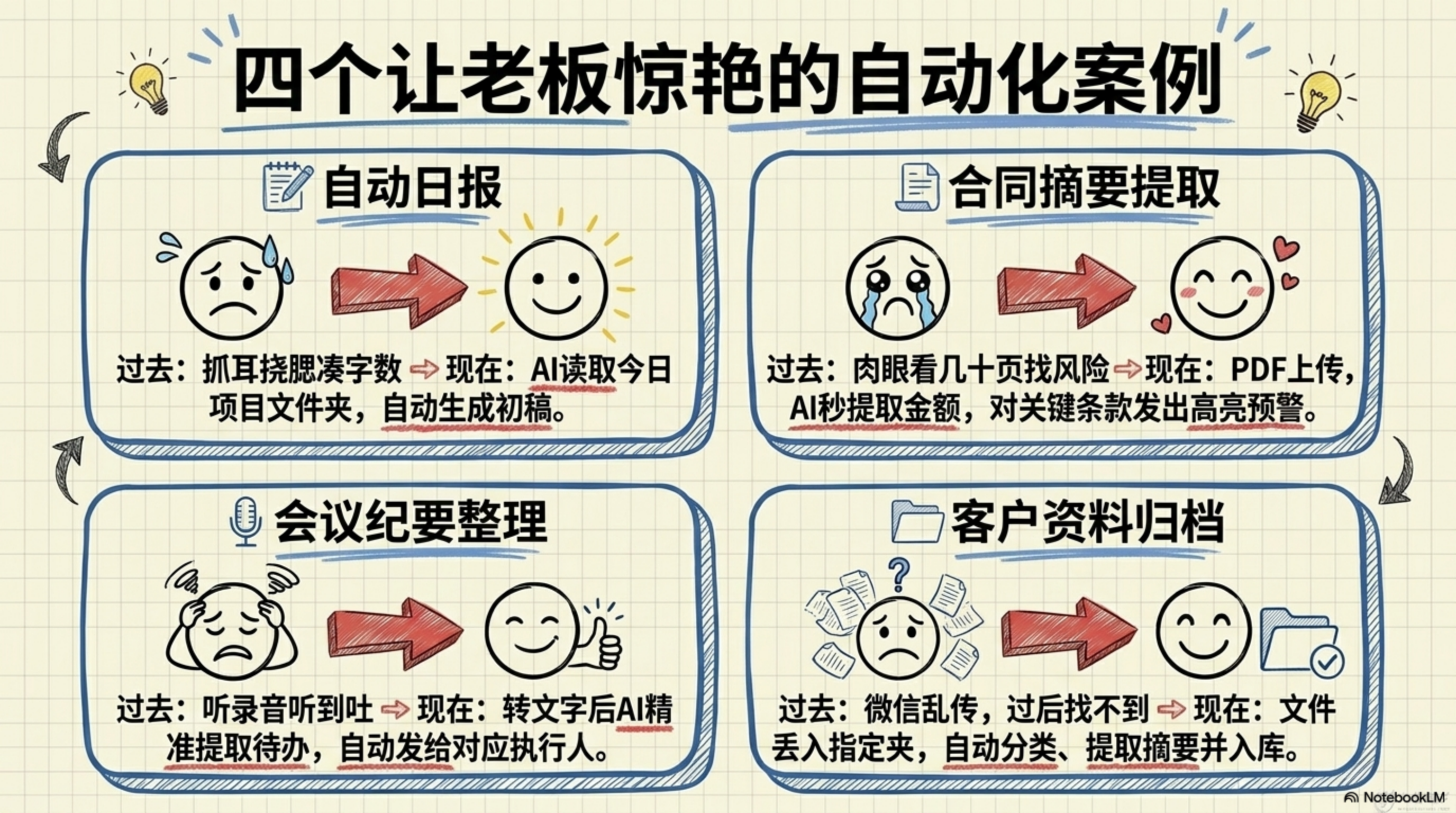

六、四个真实自动化案例:把 AI 变成你的“数字员工”

- 案例一:自动日报系统

- 流程: n8n每天定时读取团队协作文件夹 -> AI总结今日进度 -> 自动生成Markdown日报发送给管理员。

- 价值: 告别每天下午五点的“日报焦虑”,为管理层提供上帝视角。

- 案例二:合同风险摘要(OCR联动)

- 流程: 财务上传扫描件 -> Paperless-ngx识别 -> AI提取关键金额、违约条款、风险预警 -> 自动存入合同库。

- 价值: 秒级识别,规避法务盲点。

- 案例三:会议纪要与待办追踪

- 流程: 上传录音 -> AI语音转文字 -> 提取决议事项 -> 自动同步至Nextcloud任务列表。

- 价值: 会议不再是“白开”,每一项都有落地负责人。

- 案例四:客户资料智能归档

- 流程: 接收杂乱需求文件 -> AI分类提取摘要 -> 写入对应客户文件夹并同步知识库。

- 价值: 零人工干预,让碎片化信息变为团队资产。

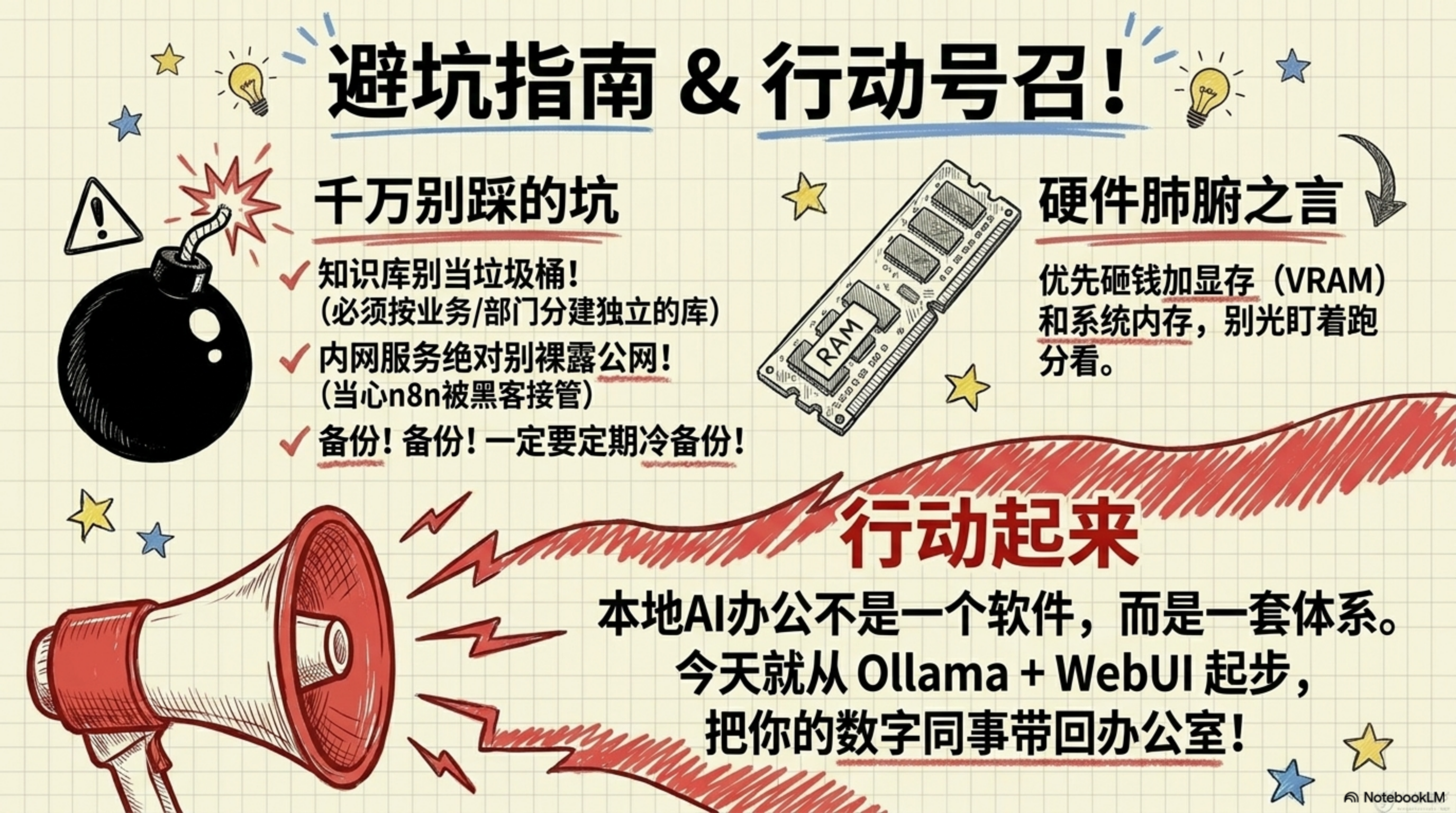

七、避坑指南 + 专业防坑贴

- 硬件优先级: 显存不够,模型会运行得像幻灯片。小团队起步建议直接上RTX 4090,不要在显存上省钱。

- 知识库调优: 严禁做“大杂烩”库。按业务拆分知识库并设置专属的System Prompt(提示词),这是提高AI“智商”的捷径。

- 安全预警: 严禁将本地服务通过端口映射直接裸露到公网! 2026年的黑客专门盯着裸露的n8n或数据库。必须使用VPN(如Tailscale)进行组网。

- 备份机制: 建议采用“冷备+定期更新”策略。AI系统一旦损坏可以重装,但你喂养了两年的私有知识库丢了就是真丢了。

八、总结:你的本地AI办公时代,从今天开始

2026年,AI的主权意识正在觉醒。那些还沉迷于将公司命脉喂给云端厂商的人,终将被数据泄露或天价订阅费所反噬。

这套本地AI办公系统不再是极客的玩具,而是你在智能化时代安身立命的基石。它不仅仅是工具,更是24小时在线、绝对忠诚、且不要工资的“数字同事”。保护好你的数字资产,别让它在云端流浪。

老朋友,在这个快速变化的时代,行动力就是唯一的护城河。现在就去下载Ollama,跑通你的第一个本地流。

(本文基于2026年最新本地AI工具实践整理,欢迎转发给正在被云端AI折磨的同事或朋友)