目录

- 目录

- 一、先把话说透:这些工具不是“谁更强”,而是“谁更适合你”

- 二、先给结论:2026 年最值得关注的 5 个本地部署工具

- 三、维度 1:谁最容易上手?

- 四、维度 2:谁的兼容性最强?

- 五、维度 3:谁跑得最快?

- 六、维度 4:谁最省资源?

- 七、维度 5:谁的模型生态更舒服?

- 八、维度 6:谁的功能最多?

- 九、维度 7:谁最适合开发者和自动化集成?

- 十、维度 8:谁的社区最活,谁更不容易“突然死掉”?

- 十一、维度 9:隐私和安全,谁更靠谱?

- 十二、维度 10:谁更值得长期投入?

- 十三、最终排名,不绕弯子

- 十四、按人群给你最直接的选购建议

- 十五、最后一句真心话:别一开始就追“最强”,先追“能用起来”

如果你最近也在折腾本地大模型,大概率已经被一堆名字绕晕了。

有人说新手无脑上 LM Studio,有人说开发者只配用 Ollama,还有人一句“想要极致性能就上 llama.cpp”,听起来都对,真到自己装的时候还是会卡住:

- 我只是想本地跑个模型,为什么工具比模型还难选?

- 我是 Mac 用户,到底谁更顺手?

- 我想接 API、做 Agent、做知识库,应该从哪个开始?

- 我电脑配置一般,是不是根本没资格玩本地部署?

别急,这篇文章不跟你兜圈子。

我把目前本地部署里最常被提到的几类工具拉出来,按 10 个维度做了一次更接地气的横向对比。先说最终结论:

- 你要省心、稳定、还能接各种应用,优先选

Ollama - 你是纯小白,想“下载就能聊”,优先选

LM Studio或Jan - 你追求极致性能、兼容性和可折腾空间,选

llama.cpp - 你想玩插件、微调、多模态、各种高级玩法,选

text-generation-webui vLLM很强,但它更像“企业级后端引擎”,不是普通人第一天就该上的东西

如果你只想看一句话版本,那就是:

普通人装本地大模型,先从 Ollama 开始;只有当你明确知道自己为什么不用它时,再考虑别的。

下面我们展开说。

一、先把话说透:这些工具不是“谁更强”,而是“谁更适合你”

很多测评最大的问题,就是喜欢把所有工具放进一个排行榜里,最后给你一个“总分第一”。

但本地大模型这件事,本质上不是选手机,也不是选耳机。它更像选操作系统,或者说,选你未来半年要不要天天打交道的一套工作台。

同样一台电脑:

- 新手在

LM Studio里可能 10 分钟就能跑起来 - 开发者在

Ollama里 30 分钟能把 API 和工作流全接好 - 硬核玩家用

llama.cpp手动编译,能把一台旧机器压榨到极限

所以这次对比,我不只看跑分,也不只看“能不能装”。我重点看 10 件真正影响体验的事:

- 好不好上手

- 支持哪些平台和硬件

- 速度快不快

- 吃不吃资源

- 模型生态全不全

- 功能够不够多

- 能不能接 API 和自动化

- 社区活不活

- 隐私安不安全

- 长期值不值得投入

二、先给结论:2026 年最值得关注的 5 个本地部署工具

这次重点看 5 个:

OllamaLM Studiollama.cpptext-generation-webuiJan

顺便单独说一句 vLLM。

它很重要,但它更像后端推理引擎,不太像 Ollama、LM Studio 这种“装上就能直接用”的终端产品。你可以把它理解成“很多高并发服务背后的发动机”,而不是第一天就要亲自开的那辆车。

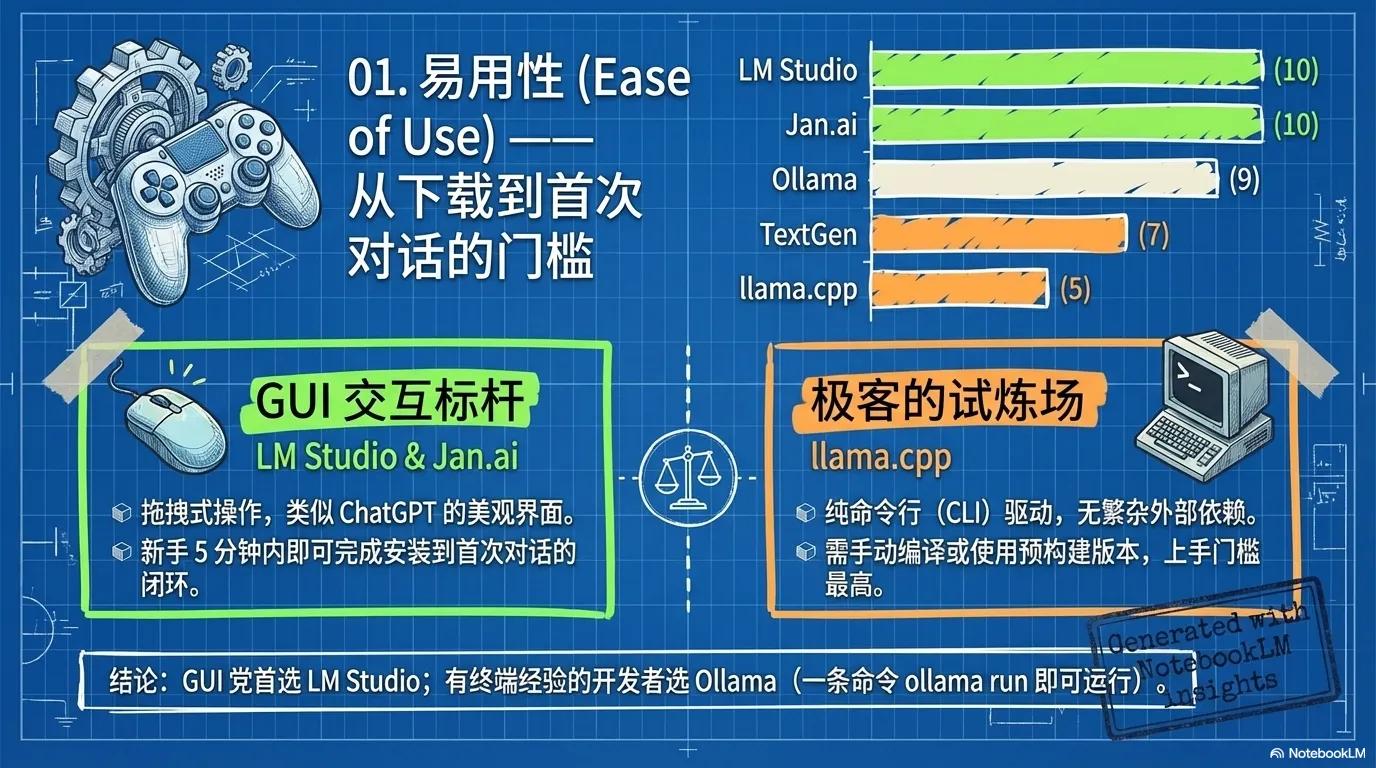

三、维度 1:谁最容易上手?

如果只看“装完就能用”,答案其实很明确。

第一梯队:LM Studio、Jan

这两个工具最适合完全没命令行经验的人。

你下载客户端,打开界面,搜模型,点下载,加载完成后就能开始聊天。整个过程非常像装一个桌面软件,而不是在“部署大模型”。

LM Studio 的优势是成熟、直观,模型搜索和下载体验也更完整。你几乎不用理解太多底层概念,就能把第一轮体验跑通。

Jan 则更像一个“本地版 AI 工作台”。界面友好,交互舒服,对于想做文档问答、个人知识库这类事情的人,也更容易产生继续用下去的冲动。

第二梯队:Ollama

Ollama 不属于“纯小白无脑型”,但它已经把命令行的门槛压得很低了。

很多人第一次用它,只需要记住一句:

ollama run qwen3

它最大的优点不是“界面好看”,而是你几乎不用处理一堆复杂配置。模型拉取、加载、运行、提供接口,这些步骤它都帮你包好了。

如果你能接受一点点命令行,Ollama 的学习成本其实非常低,但后劲很大。

第三梯队:text-generation-webui

它表面上是 Web UI,看起来好像不难,但真用起来,你会发现它属于“入口不高,深入很深”的那种工具。

优点是功能极多,缺点也是功能极多。选项太多、插件太多、玩法太多,对新手来说很容易从“哇好强”变成“这都啥”。

最后一个:llama.cpp

llama.cpp 不是给怕折腾的人准备的。

它的定位从来不是“让每个人都能舒服点几下”,而是“给愿意动手的人一个最底层、最硬核、最可控的引擎”。

如果你不会编译、不会调参数、不想碰底层,那它大概率不是你的第一站。

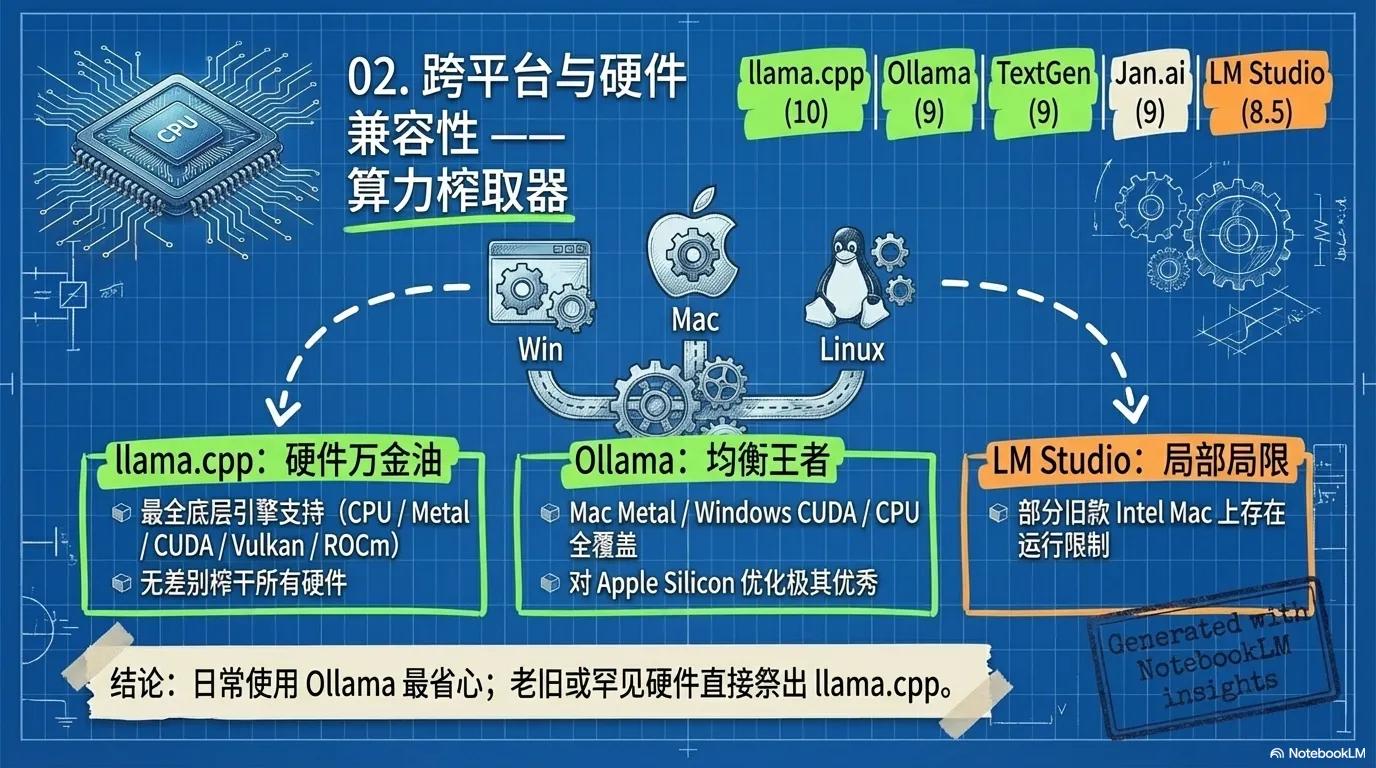

四、维度 2:谁的兼容性最强?

如果这轮只选一个“硬件万金油”,我会把票投给 llama.cpp。

原因很简单:它够底层,也够广。

无论是 CPU,还是 NVIDIA CUDA、Apple Metal、Vulkan、AMD ROCm,这套东西基本都能覆盖。甚至很多别人已经懒得管的老机器、边缘设备、非主流平台,最后也往往是 llama.cpp 在兜底。

这也是为什么很多上层工具,最后绕一圈,底层还是离不开它。

Ollama 的兼容性也很强,尤其在 Apple Silicon 上体验很好。Mac 用户普遍会觉得它“又稳又顺”,不是没有原因的。

LM Studio 跨平台做得也不错,但在一些更偏门的硬件环境下,还是不如 llama.cpp 那么能打。

一句话总结:

- 你电脑比较常规,

Ollama和LM Studio都够用 - 你机器很杂、很旧、很特殊,优先看

llama.cpp

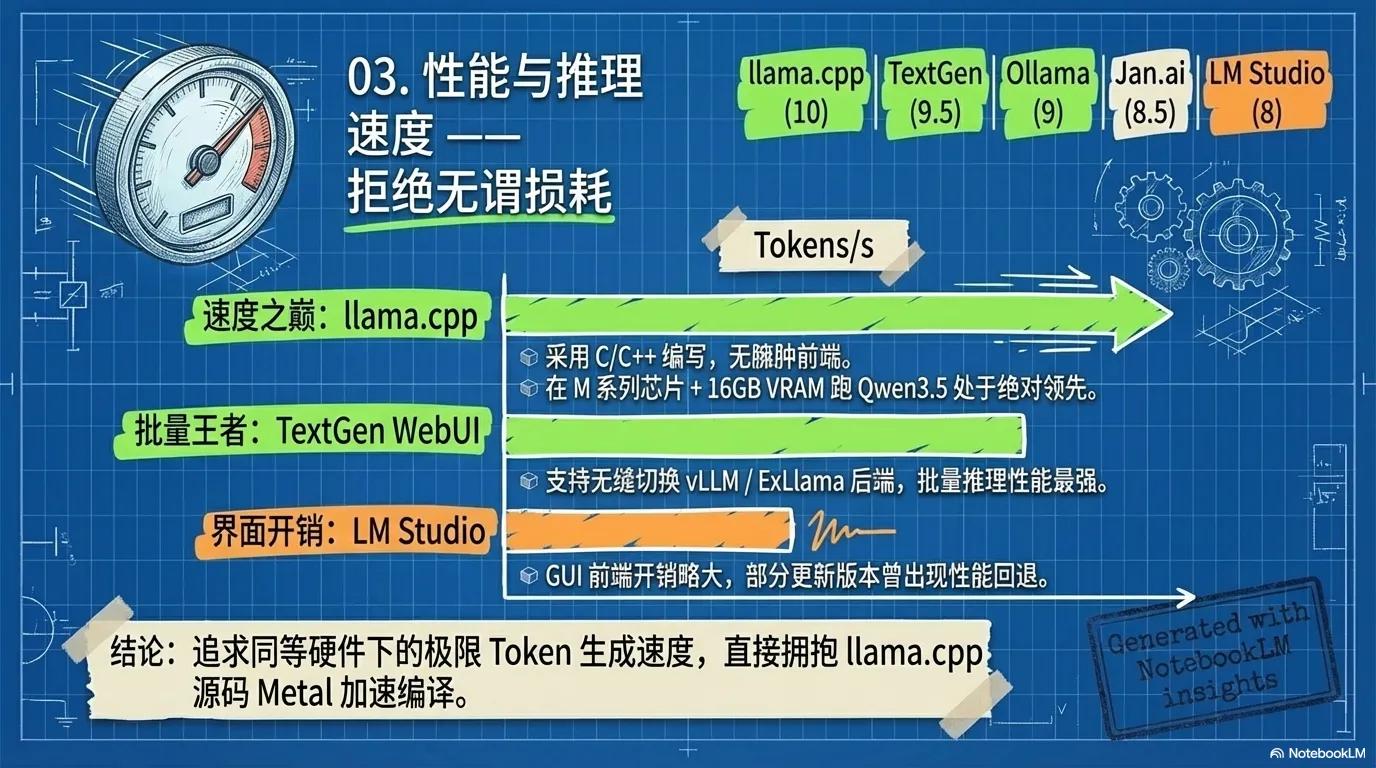

五、维度 3:谁跑得最快?

如果只谈“把同一台机器的性能榨干”,llama.cpp 依然很强。

它的优势不是营销意义上的“快”,而是那种非常朴素、非常底层的快。少一层封装,少一层损耗,很多地方都在为推理效率服务。

但这里有个很容易被忽略的事实:

大部分人感受到的“快不快”,不只是 tokens/s,还包括你从下载模型到第一次跑通,到后面接应用、做工作流,整个过程到底顺不顺。

从这个角度看:

llama.cpp是“纯性能派”Ollama是“性能和易用性的平衡派”LM Studio是“性能够用,体验优先”Jan更偏“响应体验”和桌面工作流text-generation-webui在切换到更强后端时,上限会很高

如果你只是本地聊天、写作、简单编码,Ollama 的速度通常已经够舒服了。

如果你在意极限性能,或者要压榨硬件,才值得认真研究 llama.cpp。

至于 vLLM,它的强项主要体现在更高吞吐、更高并发的服务场景。也就是说,它更像“多人同时用时更猛”,而不是你一个人本地开个窗口时就一定体感碾压。

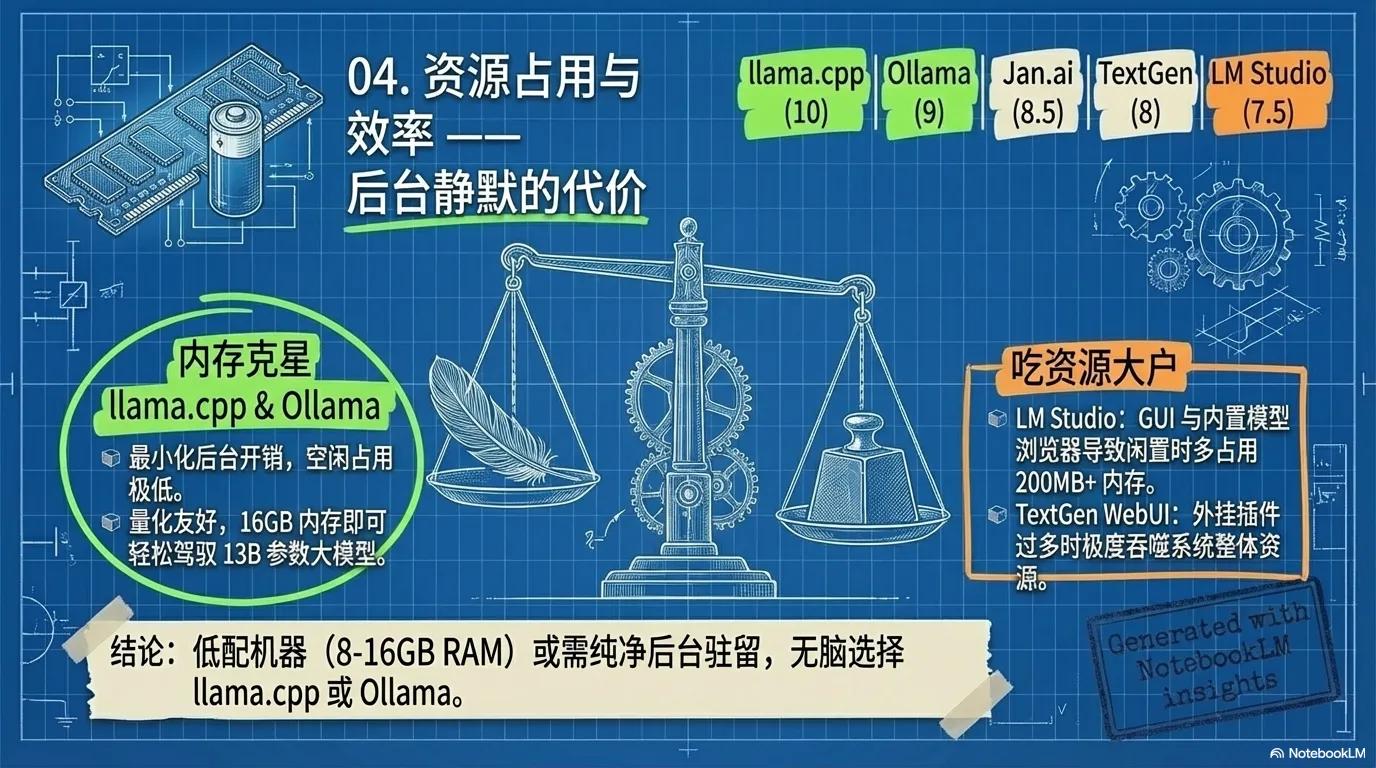

六、维度 4:谁最省资源?

这件事对低配机器特别重要。

因为很多人不是没有兴趣玩本地模型,而是电脑根本扛不住那些“看起来很强”的方案。

在资源效率这块,llama.cpp 依然是公认的狠角色。它对内存和运行时开销控制得非常凶,很多设备能不能活,全靠它兜着。

Ollama 的资源表现也不错。虽然有自己的封装层,不可能像 llama.cpp 那么“贴地飞行”,但换来的好处是省事、稳定,而且大部分主流场景下这点额外成本完全能接受。

最容易变成“资源黑洞”的,通常是 text-generation-webui。不是它不强,而是它太能装了。前端、插件、多模态、附加组件一上来,内存和显存压力自然会抬上去。

所以如果你电脑配置一般,我会这样建议:

- 低配优先:

llama.cpp - 兼顾省心和资源:

Ollama - 想玩花活再上:

text-generation-webui

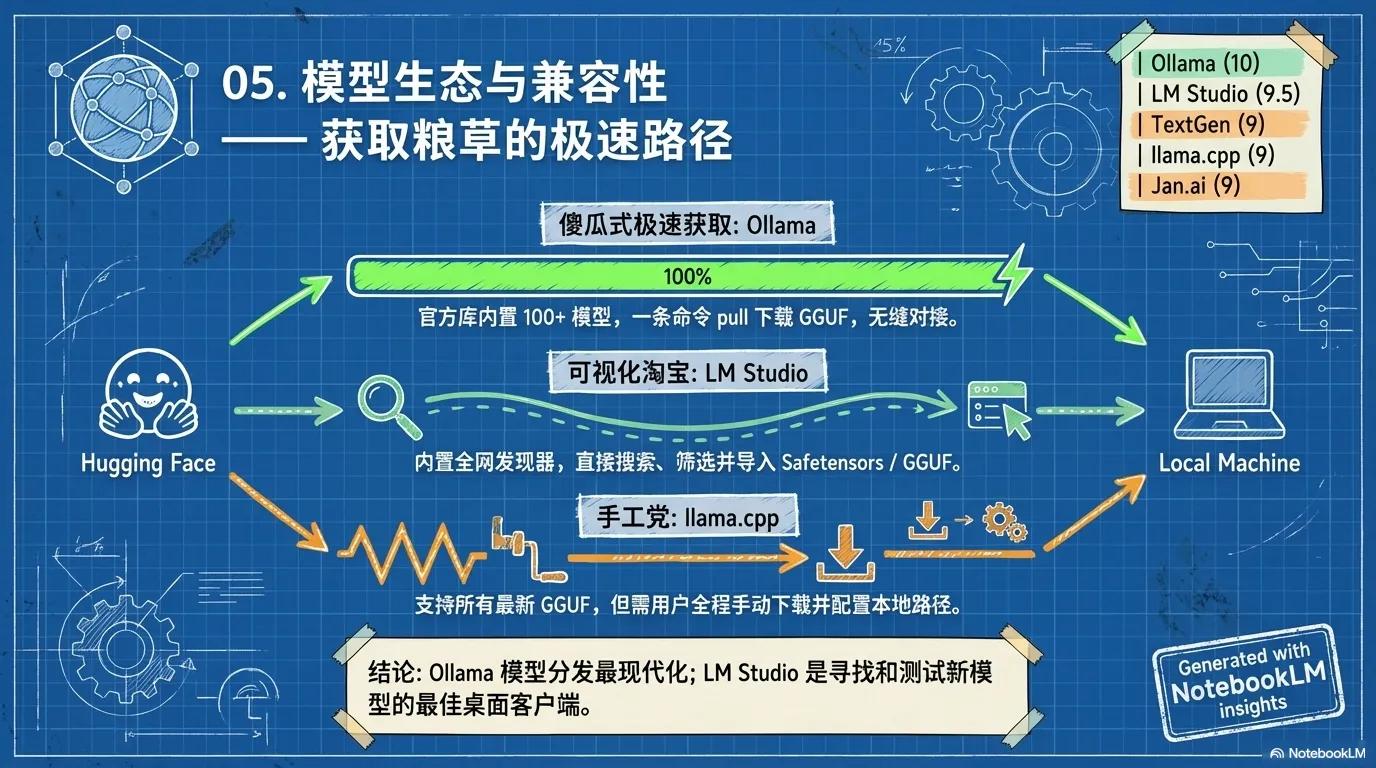

七、维度 5:谁的模型生态更舒服?

这里的“生态”,说白了就是两件事:

- 能不能方便地找到模型

- 找到之后能不能顺利跑起来

Ollama 在这件事上做得非常讨巧。它不是最开放的那个,但它很会做“筛选过后的好用”。对普通用户来说,这种体验反而更值钱。

你不需要在一堆模型页里来回比对,也不用先理解各种量化格式,先跑起来再说。

LM Studio 的优势是“找模型这件事本身就很舒服”。它把模型搜索、筛选、下载、切换这些动作做得非常直观。很多人第一次真正感受到“本地模型原来也没那么难”,其实就是从这里开始的。

llama.cpp 虽然是很多格式和工具链的底层根基,但它对普通用户不够友好。你会更频繁地接触转换、编译、参数这些问题。

简单说:

- 想少操心,选

Ollama - 想找模型更方便,选

LM Studio - 想全都自己控,选

llama.cpp

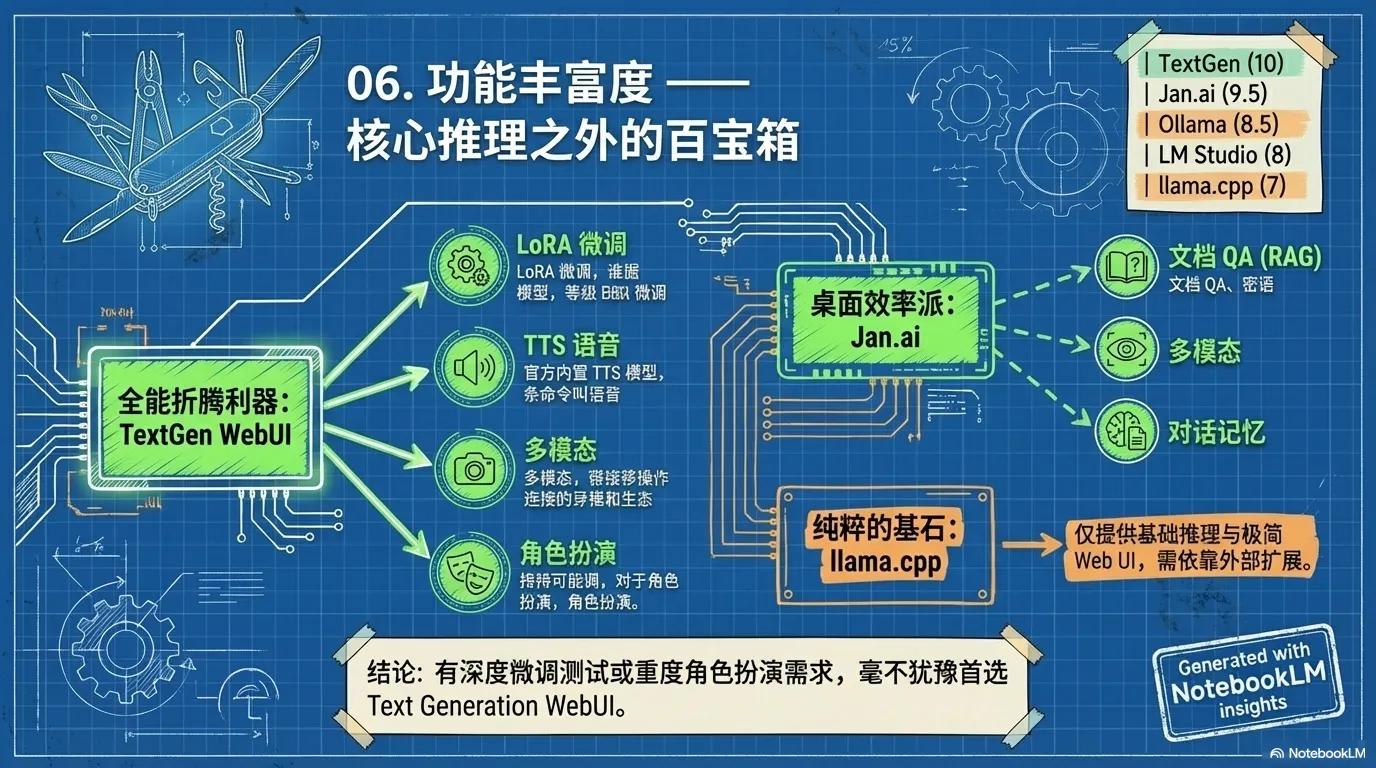

八、维度 6:谁的功能最多?

这轮的“功能王”,基本没有悬念,就是 text-generation-webui。

它最像一个大型实验场:

- 插件多

- 模式多

- 可调项多

- 玩法多

你想微调、折腾 LoRA、接各种高级能力,它通常都能给你留入口。

但要注意,功能多和适合你,不一定是同一回事。

很多人上来就装最全的,结果不是效率更高,而是每天在设置页里迷路。

Jan 在这方面反而很讨喜。它不是最全,但更偏“够用而且完整”,尤其是文档问答、知识库这类贴近日常生产力的能力,更容易让普通用户留下来。

Ollama 本体很克制,但它有一个很现实的优势:很容易和别的前端或应用配合。

这意味着它自己不一定什么都做,但它很适合做整个本地 AI 工作流里的“底座”。

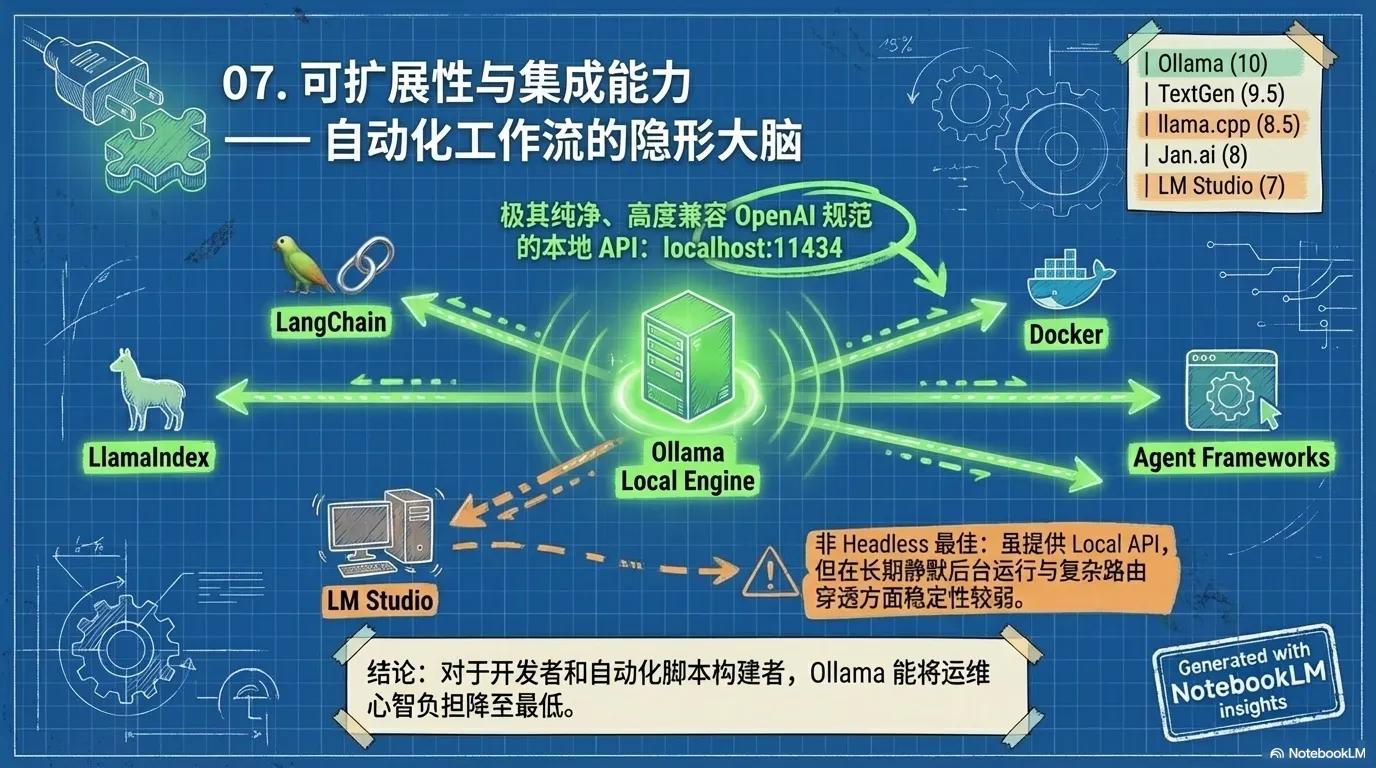

九、维度 7:谁最适合开发者和自动化集成?

这一轮,Ollama 几乎是默认答案。

原因就一句:它太适合接东西了。

你无论是想接:

- 自己写的脚本

- 本地知识库

- 自动化工作流

- Agent 框架

- OpenAI 兼容接口应用

Ollama 基本都能比较丝滑地接上。

它不是功能最花哨的,但它是最容易变成“基础设施”的那个工具。很多人本地部署折腾一圈,最后留下来的,往往也是它。

llama.cpp 也能接,而且对于嵌入式、定制化场景很有优势。但问题是,它更依赖你自己的工程能力。你需要自己处理更多服务层的事情。

LM Studio 也不是不能开服务模式,但整体气质还是更偏桌面端工具,不像 Ollama 那么适合长期当后端用。

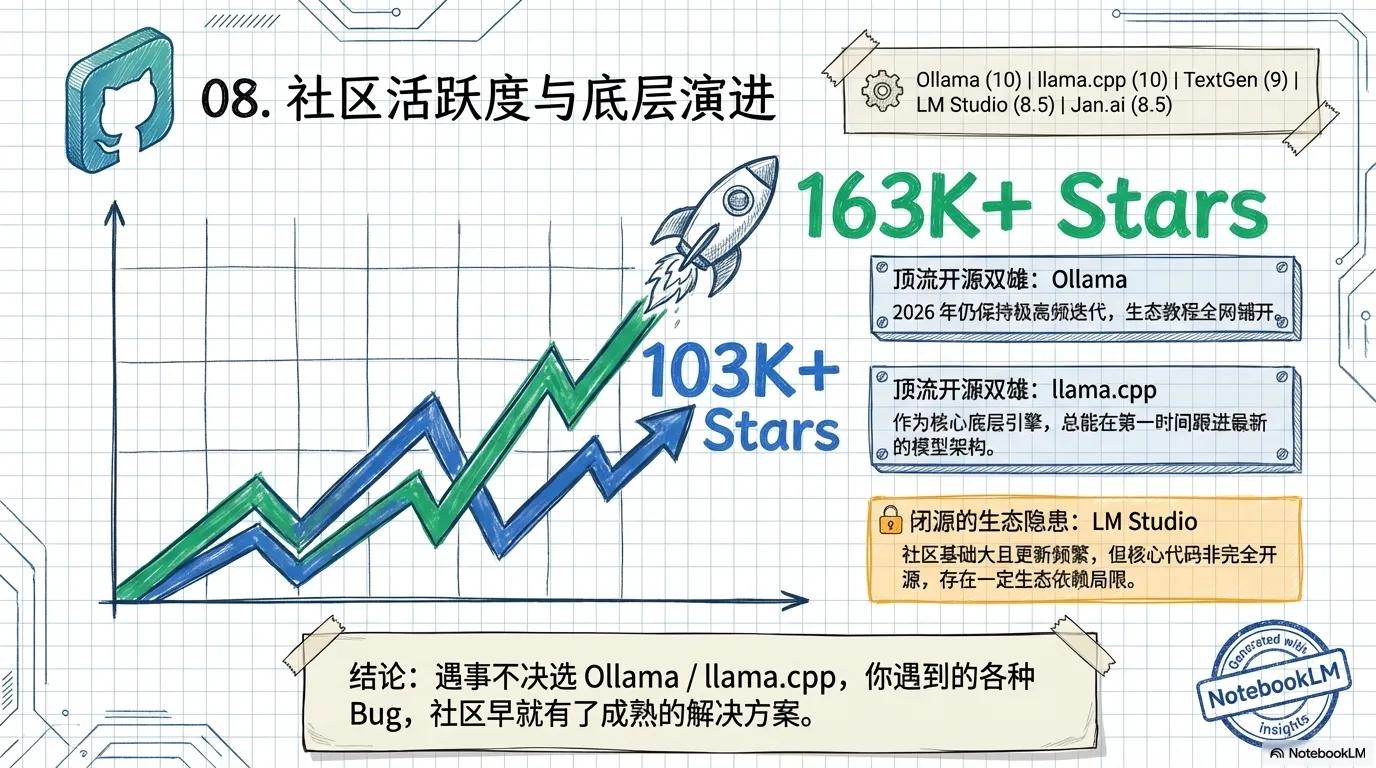

十、维度 8:谁的社区最活,谁更不容易“突然死掉”?

开源工具有一个很现实的问题:今天很火,不代表明年还活着。

所以社区活跃度,不只是看热闹,更是在看这东西值不值得你投入时间。

从目前的热度和讨论度来看:

Ollama依旧是最出圈的那一个llama.cpp是底层世界里的常青树text-generation-webui有很强的高级用户盘Jan虽然更偏新锐,但势头不差

如果你担心“我花时间学了,结果项目黄了怎么办”,那优先选社区更大、更新更稳定的工具,永远没错。

这也是为什么我更愿意把 Ollama 当成大多数人的默认推荐。

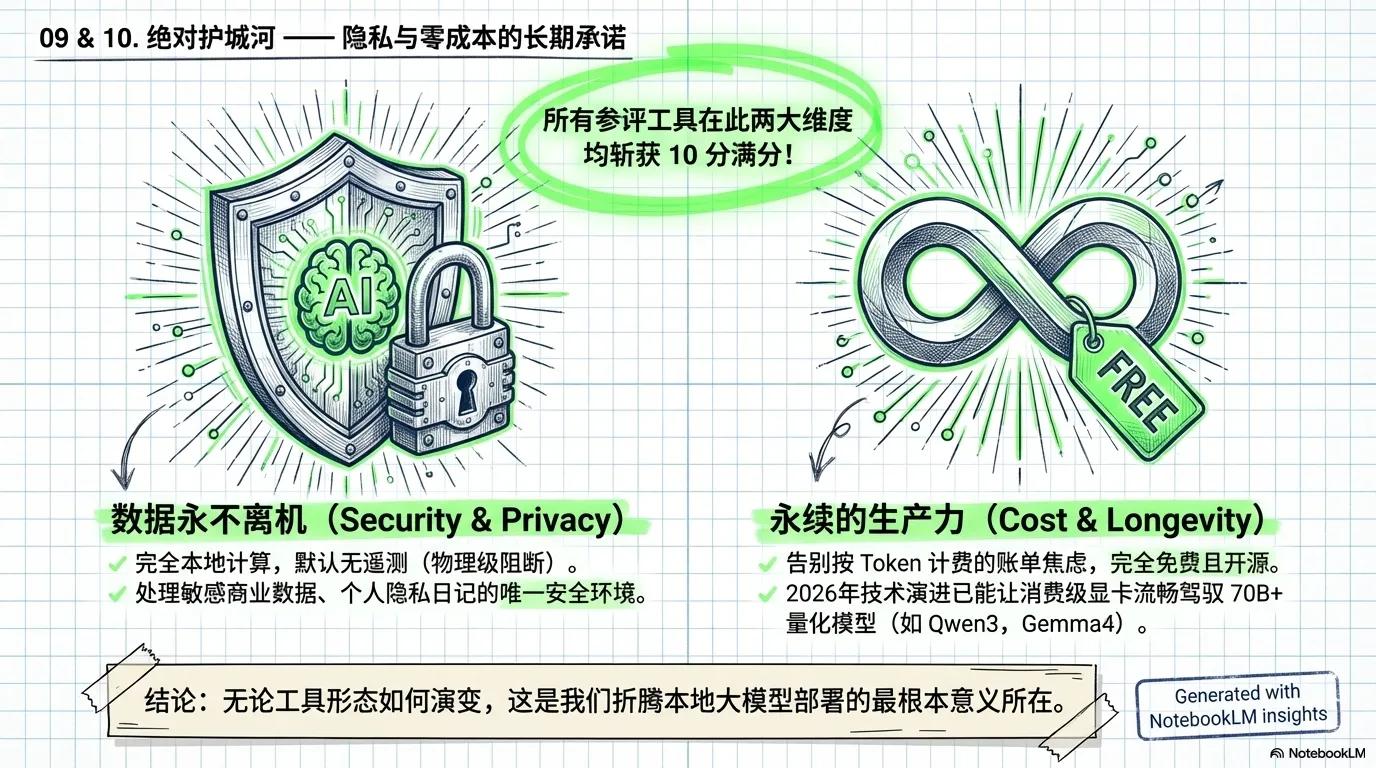

十一、维度 9:隐私和安全,谁更靠谱?

这一点上,这几类主流本地工具的核心优势其实一致:

数据不出本地。

只要你是离线跑模型,不把内容主动发到第三方服务,隐私安全就天然比云端 API 更可控。

尤其是涉及:

- 内部资料

- 客户文档

- 代码仓库

- 个人笔记

- 敏感业务数据

本地部署的意义就很大。

所以如果你在意隐私,这些工具都值得看。真正拉开差距的,更多还是体验、生态和适配能力,而不是“谁更本地”。

十二、维度 10:谁更值得长期投入?

如果你只想偶尔玩玩,那几乎选谁都行。

但如果你想把本地大模型真正接进自己的工作流,长期可用性就很关键。

我会重点看三件事:

- 社区是不是持续在更新

- 新模型出来后,跟进快不快

- 工具是不是容易嵌进你未来的使用场景

按这个标准看:

Ollama最适合长期当底座llama.cpp最适合长期当底层能力储备LM Studio和Jan最适合作为个人桌面入口text-generation-webui最适合作为实验平台

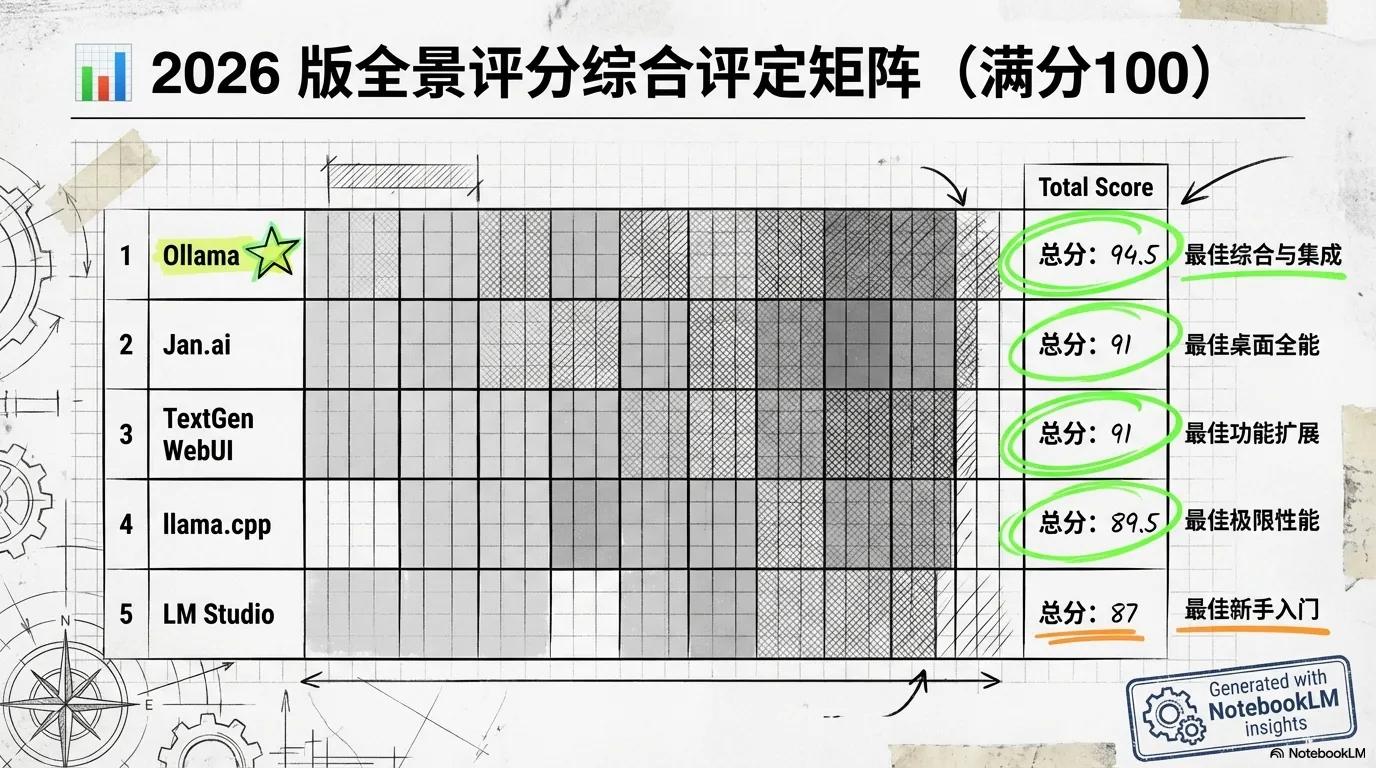

十三、最终排名,不绕弯子

如果非要给一个更贴近现实的综合结论,我会这样排:

1. Ollama

最均衡,最省心,最适合当默认选项。

它不是每一项都第一,但它几乎没有明显短板。对大多数想认真用本地模型的人来说,这比单点最强更重要。

2. text-generation-webui

功能上限极高,适合深度玩家。

如果你就是爱折腾,喜欢把所有能力都堆到一个平台里,它会让你很爽。但如果你只是想高效用起来,它也可能把你折腾得很累。

3. Jan

比很多人想象中更值得关注。

它的优势不是“最强”,而是“好用、顺手、像产品”。对于想把本地 AI 真正用进日常工作的人来说,这点很重要。

4. llama.cpp

硬核圈的常青树,性能党和底层党绕不过去。

它不是为所有人准备的,但只要你进入那类场景,就会明白它为什么一直有地位。

5. LM Studio

依然是新手友好型选手。

如果你的目标是最快跑通第一次本地部署体验,它依旧很值得装。但如果你后面越来越偏开发和自动化,你大概率还是会转去 Ollama。

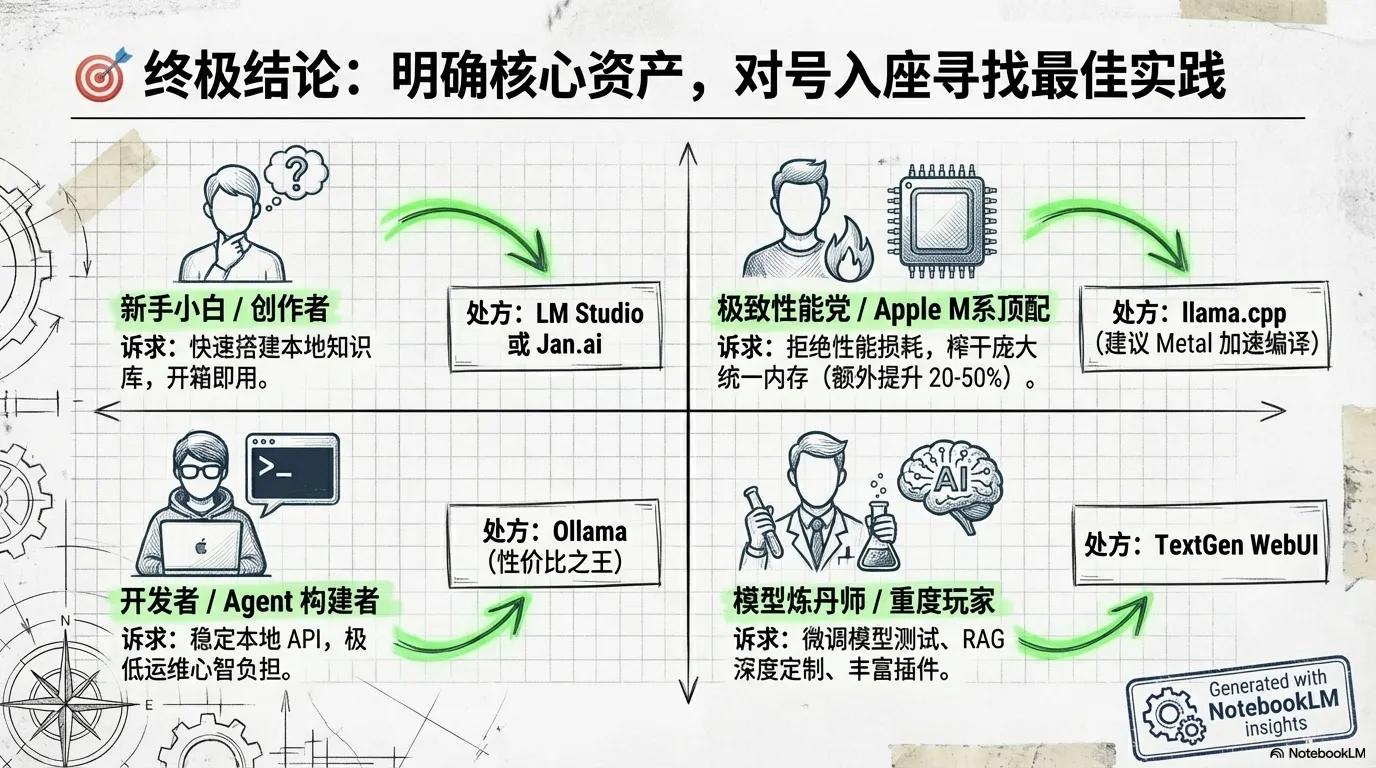

十四、按人群给你最直接的选购建议

如果你是新手

先装 LM Studio 或 Jan。

目的不是一步到位,而是先建立正反馈。先让自己感受到“原来本地跑模型没那么难”,后面再考虑要不要迁移到更强的工具。

如果你是开发者

直接上 Ollama。

别犹豫。你后面大概率要接 API、接脚本、接工作流、接 Agent,这时候 Ollama 的价值会越来越大。

如果你是性能党

去研究 llama.cpp。

它不一定让你最轻松,但大概率能让你最服气。

如果你是实验型玩家

装 text-generation-webui。

你会在里面找到大量“还能这么玩”的空间,但前提是你愿意为复杂度买单。

如果你是内容创作者或知识工作者

优先看 Jan,其次 LM Studio。

因为你真正要的不是一堆技术名词,而是更顺手的交互、更低的摩擦,以及“今天就能拿来干活”。

十五、最后一句真心话:别一开始就追“最强”,先追“能用起来”

很多人折腾本地大模型,失败不是因为电脑不够强,也不是因为模型不够好,而是因为一上来就想把所有东西一次性配齐。

其实完全没必要。

本地部署最好的路径从来都不是“最强配置”,而是:

- 先选一个最容易跑起来的工具

- 用它真的解决几个问题

- 再根据自己的场景升级

如果你问我,今天只能推荐一个给大多数人,我还是会选:

Ollama。

因为它最像那个能陪你从“试试看”走到“真用起来”的工具。

而如果你只是想最快体验一次“我的电脑也能跑本地大模型”,那就从 LM Studio 开始。

别怕选错。真正重要的不是你第一步选了谁,而是你有没有迈出第一步。